Skillbyte Podcast #54: Edge Computing

Willkommen zum Skillbyte-Podcast! Skillbyte ist Ihr Partner für digitale Exzellenz.

In diesem Podcast geht es um das Thema: Edge Computing

// Inhalt //

01:44 - Was ist Edge Computing und wo wird es eingesetzt?

07:24 - Vorteile beim Edge Computing

09:31 - Nachteile beim Edge Computing

12:51 - Anwendungsfälle

17:18 - Edge Computing auf dem Smartphone

20:03 - Echtzeitdatenverarbeitung

22:45 - Die Rolle von 5G beim Edge Computing

Abonnieren Sie diesen Podcast und besuchen Sie uns auf https://www.skillbyte.de

Feedback und Fragen gerne an podcast@skillbyte.de

AUTOMATISCH ERZEUGTES TRANSKRIPT

Geht also darum, Computing Ressourcen Computing Power an die Peripherie zu verlegen. Was Daten sammeln kann, verarbeiten kann, Daten gefiltert werden können, Daten auch gecrasht werden können, wenn die Verbindung zum Internet z.B. abreißt, dann gehen Daten verloren. Wenn ich aber so ein Edge weiß hab, kann das die weiß dann Daten erst einmal zwischen Cassian in seinem Puffer, bis die Internetverbindung wieder da ist. Also es bietet viele, viele Vorteile.

Herzlich Willkommen zum Skillbyte Podcast Nr. Vierundfünfzig Edge Computing Abonniert unseren Podcast für mehr spannende Themen aus dem Technologie Umfeld, wenn er IT Entscheider oder die Fachkraft seid. Wir freuen uns über Hörer Fragen insbesondere auch von Bewerbern an Podcasts Skillbyte Punkte. Wir freuen uns auch über Bewertungen und über weitere Weiterempfehlung an eure Freunde und Kollegen, die sich ebenfalls für das Thema Technologie interessieren. Schaut doch auf der Skillbyte Slash Jobs Seite vorbei. Wenn ihr wissen wollt, welche Positionen wir gerade anbieten.

Ich bin heute hier wieder mit einem Stargast Masiar Hallo Masiar Hallo Maurice.

Freut mich wieder dabei zu sein.

Ja wunderbar. Ich freue mich auch ganz besonders mit Dir über dieses ja doch Trendthema Computing zu sprechen, weil du ja auch da schon einige Expertise aufgebaut hast. Und ich hab in der letzten Zeit viel Nebulöses darum gehört und wollte das einfach mal klarstellen, was ETH Computing eigentlich ist, was die Herausforderungen sind und welche Möglichkeiten heute schon bestehen und wie das auch mit 5G zusammenhängt. Das es ja auch immer wächst, immer mehr zusammen in der letzten Zeit. Vielleicht sollten wir kurz sagen bei Edge Computing, also Kante oder Rand des Netzwerkes.

Deshalb heißt es Edge Computing, wenn die Informationen in der Peripherie bzw. am Ort ihrer Entstehung verarbeitet und nicht erst in ein zentrales Rechenzentrum zusammengeführt. Was heißt das konkret? Das können Sensoren sein, die in industriellen Maschinen eingebaut sind, die sozusagen irgendwelche Werte messen vor Ort und dann nur ein Signal oder Daten übertragen an den Steuerungs Computer. Wenn gewisse Schwellenwerte überschritten werden. Das ist z.B. ein ganz einfaches Beispiel und das macht insbesondere dann Sinn, wenn sehr, sehr, sehr, sehr, sehr viele Daten direkt erfasst werden und wirklich nur bei außergewöhnlichen Daten, Mustern, Benachrichtigungen erfolgen muss.

So ein Flugzeug zur Biene wird z.B.. Ich glaube das ziemlich plastisch ist. Laut Cisco entstehen innerhalb von 30 Minuten Flugzeit in einer einzelnen Flugzeug Turbine heute schon etwa 10 Terabyte an Daten. Das entspricht ungefähr 5 000 Stunden HD Videos, die während des Fluges verarbeitet werden müssen, um zu prüfen, ob die Turbine ordnungsgemäß funktioniert. Also die ist voller Sensoren und da möchte man natürlich nicht die ganzen Daten permanent verarbeiten oder übertragen müssen, sondern nur wenn es relevante Änderungen gibt in der Turbine oder in der Charakteristik von der Turbine.

Fällt dir noch ein Beispiel ein zum Thema Edge Computing also grundsätzlich um? Ich habe mal die gegenteilige Architektur oder Infrastruktur nochmal zu erklären. Wenn ein Device Daten oder ein klein sagen wir mal Daten direkt bei der Abnahme zum Server schicken, dass wir die normale oder herkömmliche Variante nur dadurch, dass gerade durch 5G und IP V6 jedes Gerät quasi eigenständige Entität im Internet wird und anfängt Daten zu senden, dann könnte man das gar nicht Server technisch richtig abbilden oder sehr teuer abbilden.

Geht also drum Computing Ressourcen Computing Power an die Peripherie zu verlegen, was Daten sammeln kann, verarbeiten kann oder eine Vorfach Verwaltung vornehmen kann. Das heißt im Prinzip wie so ein Distributed Computing, wo eine gewisse Verarbeitung an der Edge passiert.

Daten gefiltert werden können, Daten auch gekuscht werden können.

Wenn die Verbindung zum Internet z.B. abreißt, dann gehen Daten verloren. Wenn ich aber so ein Edge weiß hab, kann das die Weismann Daten erst mal zwischen Cassian in seinem Puffer, bis die Internetverbindung wieder da ist. Also es bietet viele, viele Vorteile und es gibt ganz viele Beispiele. Ich aus meinem direkten Umfeld. Wenn z.B. in einem Lager Thema Logistik Daten erfasst werden von Sensoren von Scannern, dann werden zum Teil die Scanner selber sehr viel intelligenter und übernehmen Aufgaben eines Edge Devices bis hin zu kleinen Boxen, die irgendwo im Lager installiert sind, wo der Scanner über WLAN die Daten erst mal hinschickt, dort diese besagte Filterung vor Verarbeitung Caching stattfindet und es dann zum Server geschickt wird.

Also im Grunde, dass man erst einmal sammelt zwischen aggregiert und dann das Ergebnis an den Server liefert, so wie man das auch bei einer menschlichen Verarbeitung machen würde.

Berger Genau. Wenn man so ein hierarchisches Unternehmen hat, dann berichtet man ja in der Hierarchiestufe da drüber oder berichtet man an diese Stufe ja auch nur letztlich die Ergebnisse oder die nächsten Maßnahmen, die man ergreifen möchte. Und nicht jedem kleinen Datenpunkt mehr schon muss sich das so vorstellen. Wenn so Sensoren Daten erfassen, dann kann das, wenn das mit nach hohen Sampling Rate stattfindet und du hast mal im vielleicht in einer einzigen Fabrik bei Gesprächen ist noch nicht einmal von internationalen Konzernen, die vielleicht zu Echtzeit alle ihre Fabrik überwachen wollen.

Dann kommt das quasi wenn ich da so Server sich sehe ja schon einem Denial of Service. Tacke gleich. Deswegen ist es notwendig, dass sich Daten einfach vor filtere Domains wie bei der Turbine. Wenn die jeden Datenpunkt abliefern würde, dann wäre der Borth Rechner sozusagen völlig überlastet.

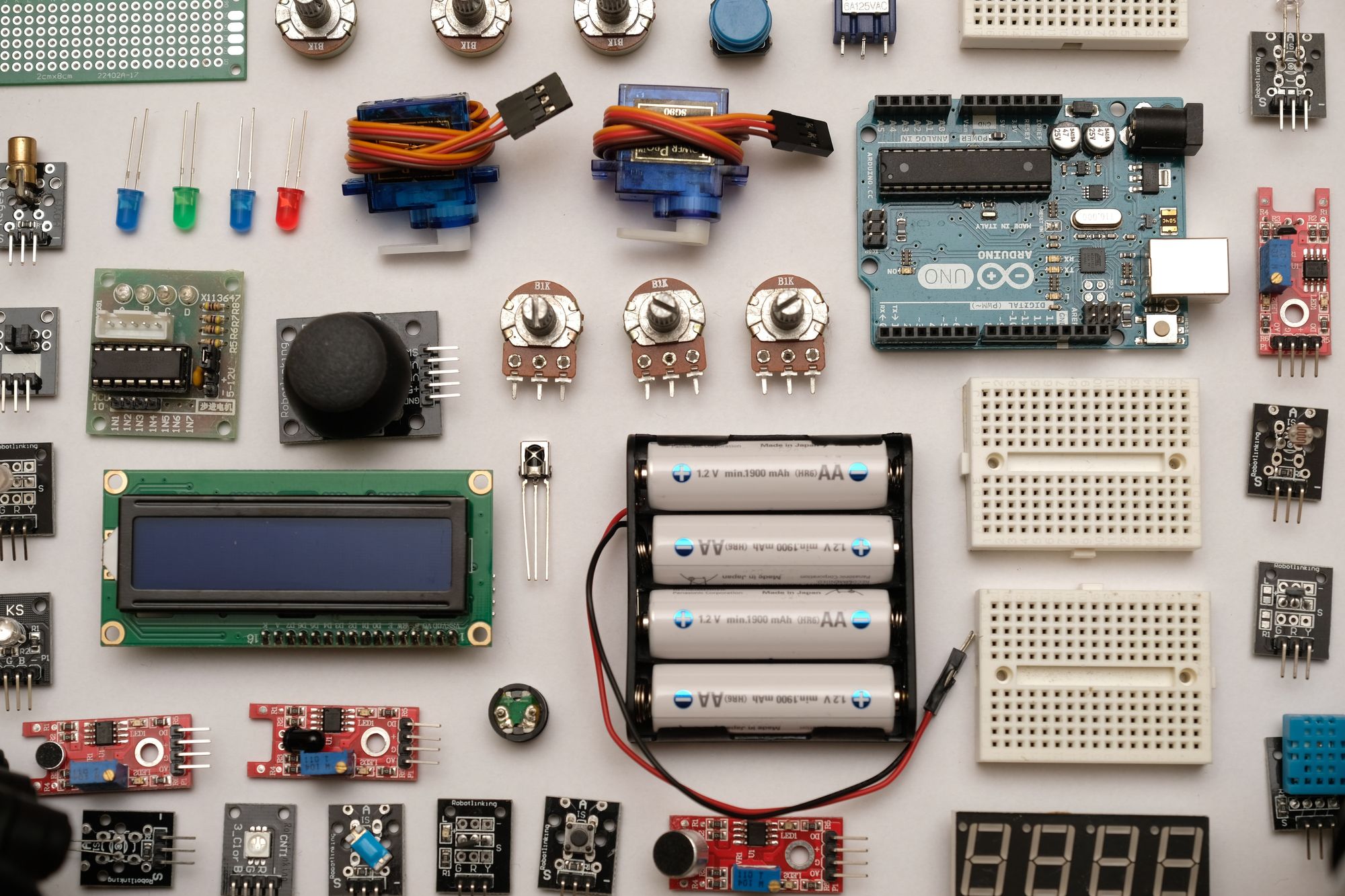

z.B. Ja genau und neun und neunzig komma neun und neun prozent der Datenpunkte würden quasi sagen Ja, alles okay, alles okay, alles okay so. Das heißt, er würde keinen Mehrwert geschaffen. In dem Zusammenhang habe ich auch schon von dem Begriff im Gegenzug zu Cloud-Computing zu Fork Computing gehört, wo es halt darum geht, dass die Edge oder die der Sensor halt smarter wird. Ne, wie durch kleine Geräte wie den Raspberry PI oder auch die Apple erträgst dies jetzt seit einigen Monaten gibt.

Also kleine Geräte, die sehr günstig herzustellen sind, die aber auch aufgrund ihrer geringen Energie Anforderungen jahrelang mit einer Batterie betrieben werden können oder sogar im Solar Betrieb komplett autonom durchhalten können. Dann eben kleine Logic Chips enthalten können um gewisse Funktionen schon dort auszuführen hier diese NFC Kreditkarte wäre ja im Grunde auch das Our Edge, die weiß, wenn man möchte einen kleiner Prozessor den du mit der rumträgt und der dann nur aktiviert wird, wenn er denen ans Lesegerät hälst oder z.b.

Noch ein sehr gutes Beispiel Kamera oder soweit Inflation die auf Bewegung reagieren. Auch die können Daten natürlich filtern und Bewegungsdaten erst senden, wenn gewisse Schwellwert erreicht sind. Und dieses Processing passiert dann halt lokal. Diese die Weiche sind dann teilweise auch mit Grafik Chips ausgestattet, um Bilderkennung schnell durchführen zu können und es irrelevante Daten zum Server schicken.

Das heißt, solange die Überwachungskamera ein Standbild zeigt, muss es nicht aktiv werden. Erst wenn mit der Bewegung Sensor meldet hier bewegt sich was, dann muss die Aufzeichnung beginnen.

Genau.

Und dann spart man ja viele, viele Terabyte, wenn man nur die Bewegtbild Daten aufzeichnet und nicht das Standbild die ganze Zeit. Zum Beispiel so um nochmal zusammenzufassen Warum macht man Edge Computing? Die Vorteile liegen in der Echtzeit Datenverarbeitung direkt vor Ort. Das heißt, man hat eine geringe Latenz, da im Prinzip Echtzeit Verarbeitung möglich wird. Also so eine Security Kamera ist ein perfektes Beispiel dafür.

Die meldet hier ist Bewegung.

Hier bewegt sich was. KUG auf dem Monitor oder auf das Bildmaterial ist hier etwas gefährliches. Ein weiterer Vorteil ist den hast du schon angesprochen diese regulatorischen Anforderungen, also dass gewisse Daten den Sensor gar nicht verlassen dürfen. Du könntest jetzt ja auch so eine Kamera z.B. im Aufzug vorstellen, die einfach sicherstellt, dass im Aufzug nie mehr als 10 Personen sind. Du willst ja gar nicht die Personen erkennen oder die Gesichter erkennen. Du willst einfach nur wissen sind mehr als 10 Personen im Aufzug oder nicht?

Und wenn das Lokal auf der Kamera schon passiert, diese Gesichtserkennung oder diese Personen Erkennung, dann hat man auch hier einen Vorteil einfach Datenschutz technisch. Und ein weiterer Vorteil ist die geringe Datenmenge, die nur abtransportiert werden muss. Also durch die Aggregation müsste man im Grunde nur kann man buhlten Flack schicken, mehr als zehn Personen im Fahrstuhl oder weniger als zehn Personen im Fahrstuhl. Das ist natürlich viel weniger Daten Volumen, als wenn die kompletten Bilder der Kamera an den Server geschickt werden und der dann im Prinzip jedes Bild einzeln auswerten würde.

Ohne Spezial Prozessor, bis die Kamera machen kann. Das heißt, ziemlich viel Computing Power wandert in das edgy Weiß, also die Kamera und der Server oder der Überwachungs Server. Der kriegt im Grunde nur ein Impuls, wenn der Fahrstuhl zu voll ist. Und damit zahlt Edge Computing ja im Grunde schon voll auf die zwei Hauptprobleme des Internet of Things. Eine wenn du wie gesagt, jedes Gerät ist online und hat also eine eigene IP Adresse und sendet Daten und kann Daten empfangen, dann ist das AT Computing ja wichtig, dass man sagt Okay, ich will nur Daten senden, die wirklich wichtig sind.

Also wenn ich die Bandbreite optimal ausnutzen und dann auch in Echtzeit eben Events versenden kann und dann auch darauf reagieren kann, gibt's dann auch Nachteile beim Edge Computing?

Naja, was halt viele, die weiß ist ne, die irgendwie gar abgedeckt werden müssen, wo auch mal mechanische Ausfälle stattfinden können. Also dort viel mehr Support, Aufwand und Wartungsaufwand, weil die Geräte müssen instand gehalten werden, die vielleicht draußen sind im Freien sind. Dann auch wenn sie gewisse Schutz Richtlinien erfüllen, kann es trotzdem sein, dass sie mit der Zeit hosten oder wenn das der Kamera ist, sich irgendwas einen Vogel auf die Linse kackt oder was? Da gibt's ganz viele Beispiele.

Ich möchte es nicht noch genauer Ortsbild, was da alles passieren kann. Aber da musst du dir ja mal schauen.

Ich denke mit den Updates, das ist ein ganz wichtiges Thema, weil man hier zwei gegenläufige Entwicklung hat. Auf der einen Seite sind diese Edge, die Weiß ist, natürlich tendenziell sehr günstig, weil man viele davon im Feld hat. Auf der anderen Seite gibt's für günstige Geräte tendenziell weniger Updates. Stell dir mal vor, du gehst als böser Bube hin, montiert die Sicherheitskamera ab und. Steckt das Ethernet Kabel was jetzt nicht meine Kamera ist in deinen Laptop und kannst dann sozusagen auf das Firmen Netz zugreifen.

Diese Absicherung ist natürlich auch eine Herausforderung, um bei dem Beispiel der Kreditkarte zu bleiben in NFC. Da ist ja extra so ein Security Prozessor drauf, wenn ich das richtig im Kopf habe, der nur deine PIN Eingabe überwacht oder so, dass die PIN das Gerät die Karte niemals verlassen muss. Also das ist auf jeden Fall eine Herausforderung, da die Geräte fallen leichter aus. Das hast du schon gesagt, wenn der Vogel die Kamera ruiniert und wenn die Internetverbindung kann natürlich auch nicht stabil sein.

Also das muss man auch bedenken, wenn so eine Kamera 24 Stunden am Tag aufzeichnet und jetzt ist sie mal eine Stunde offline, was passiert dann? Werden die Daten einfach nicht erhoben, werden die zwischengespeichert und dann nach transportiert nach synchronisiert? Also da. Ich glaube die Software Architektur so kann man das sagen, die muss hat einfach diese ganzen Ausfälle kompensieren können und cleverer sein.

Wenn die Anzahl der Geräte, die mit dem Netz verbunden sind, exponentiell steigt, muss man sowieso ein anderes Paradigma her. Dann kannst du nicht mehr alles zentral verarbeiten, sondern die Geräte müssen halt intelligent genug sein, dass sie eine Art Service Mesh untereinander bilden können, die direkt miteinander kommunizieren können Machine to Maschine und selbstständig Entscheidungen treffen können, ohne dass es irgendeine zentrale Einheit gibt, wo alle Leitungen zusammenlaufen. Also ich denke, wir werden ganz schnell in die Richtung kommen, dass man sich da andere Modelle überlegen muss.

Du meinst so Mesch Netzwerke mehr, dass der eine Sensor dem anderen Sensor Bescheid gibt, der wiederum imnächsten Sensor und dass so eine Kette entsteht wie so ein Sun Lösch Eimer bei der Feuerwehr, bis dann irgendwann einen Sensor in Reichweite des WLANs ist und die Daten aggregiert dann ab laden kann.

Ja genau.

Ich glaub mit den Apple Vertex ist das im Grunde schon so, die können nur Bluetooth. Aber das ist jetzt Halbwissen. Das können vielleicht unsere Zuhörer dann nochmal klarstellen. Klappe, die können nur Bluetooth. Aber es ist so Wenn mein Tech in Reichweite meines Telefons ist, dann finde ich das. Und wenn dein eher Tech in Reichweite meines Telefons ist, dann wird das quasi auch übertragen. Dann sehe ich das natürlich nicht. Aber es wird quasi einen zentralen Server übertragen und dadurch weißt du, wo dein Tag ist.

Auch wenn ich in der Nähe bin und wir im Grunde uns nicht kennen würden oder keine direkte Verbindung untereinander haben. Ich glaube, Anwendungsfälle, wo Edge Computing heute schon genutzt wird, das ist wirklich dieses smarte Warenlager, was du gesagt hast. Also der LKW fährt einfach rein oder die Palette mit dem Gabelstapler wird reingefahren und dann durch ein Tor durch so eine elektromagnetische Schleife. Und die liest dann die Etiketten aus von dem ganzen Material, was draufgepackt ist. Ich glaube auf flottem Management, so bei Mietwagen oder auch wahrscheinlich Flotten in der Industrie.

Das hat einfach geguckt wird, dass die Fahrzeuge selber melden, wenn sie einen Ölwechsel brauchen oder verschiedene Wartungsintervalle eingehalten werden müssen. Wir hatten eben schon die Turbine, als würde ich sagen auch industrielle Maschine, die vielleicht sogar weiß, wann gewisse Teile kaputtgehen und das melden kann und vorher Bescheid geben kann, bevor wirklich was kaputt geht. Das will man ja auch machen. Ich glaube auch, ich weiß nicht, ob du das mal gesehen hast. Im Bereich der Gebäude Automation gibt es auch schon einige Beispiele.

Also ich kenne jemanden z.B. der ist wenn der wenn der Wind zu stark wird, dann wird die Markise rein gefahren oder die Rollläden fährt runtergelassen und die Antenne eingezogen und alle solche. Ich möchte jetzt nicht von Spielereien reden, weil das ist ja schon ganz gut, dass die Markise nicht kaputt geht. Vielleicht dem ein oder anderen Zuhörer ist das schon passiert und er würde sich und Sensor wünschen. Aber ich glaube auch da ist noch super viel Luft, das man im Grunde da noch sehr viele billige Sensoren in allen möglichen Geräten einbauen kann.

Ein Paradebeispiel für ETT Computing ist natürlich das selbstfahrende Auto. Das darf sich natürlich auch nicht auf die Internet-Verbindung verlassen, um Entscheidungen zu treffen. Wenn du mit 100 Stundenkilometer die Straße runter fährst, ist das da vorne ein Baum oder kann ich um die Kurve fahren? Sondern das müssen die Geräte in diesem selbstfahrenden Auto. Der Autopilot muss das alles selber entscheiden können. Lokal. Wer kann natürlich, wenn du dann in der Garage bist, ein Update ziehen übers Internet.

Aber im Moment der Entscheidung welche Spur muss ich halten und wie muss ich hier abbiegen oder kann ausfahren, muss er natürlich autark funktionieren, unabhängig davon, ob das Internet vorhanden ist oder nicht.

Beispiele, dies vielleicht auch noch nicht geben, sind denkbar ohne Ende. Stell dir vor, jetzt gerade bei der bei der Flutkatastrophe, was bei uns gewesen ist, wenn es an mehreren Stellen der Pegel regelmäßig ausgelesen wird, es halt über eine gewisse Zeit gewisse Trends erkennt und weiß, was normal, was nicht normal ist. Der sich gleichzeitig Abgleich mit anderen Stellen also bei uns war. Zum Beispiel drei oder vier Bäche, ich sage bewusst Bäche, die übergelaufen sind und sich zu reißenden Strömen entwickelt haben.

Wenn dann entlang dieser dieser Strecken mehrere Messstationen wären, die den Pegel schon regelmäßig messen, die sich auch untereinander austauschen, sagen Bist du normal, bist du normal. Und ab einem gewissen Schwellwert könnte man eine Warnung rausgeben und auch da könnten die Geräte sich untereinander abstimmen und sagen Okay, wir hatten eine Internetverbindung. Gerade der soll die Meldung rausschicken, was dann zentral vielleicht verteilt wird als Push Nachricht an alle und die Technologie dafür oder die Sensorik und die Software. Das gibts in Open Source.

Das ist alles nicht teuer.

Nur es muss halt jemand machen. Auf die Idee kommen. Okay. Das kann man so machen. Es müssen nicht sofort auch irgendwie Schwergewichte rein, die das programmieren oder umsetzen. Das lässt sich mit dir fast im Conrad Katalog erschlagen.

Ja, du musst die Sensoren bestellen und die dann einfach in. Ich weiß nicht ein Kilometer Abstand ins Wasser setzen und dann muss es halt so eine zentrale Leitstelle geben, wo im Grunde diese Daten auflaufen. Und dann. Das ist natürlich toll bis ja fast Echtzeit Daten fähig.

Na ja, gerade mit 5G können sie ja auch Daten senden oder die Geräte könnten untereinander sich absprechen. Überall 5G.

Naja, oder auch stell mir jetzt vor, an Talsperren oder an den Deichen, dass man da den Druck misst und ziemlich genau weiß, wann es kritisch wird, also vorher schon antizipiert, welche Gegenmaßnahmen wie viel Zeit benötigen und diese dann eben rechtzeitig durchführen kann und nicht, wenn es zu spät ist, im Grunde genommen auch bei Wartung von Brücken oder so bei Materialermüdung Szenarien. Ich glaube, da können diese günstigen Sensoren auch helfen.

Also der Raspberry PI, den ich weiß gar nicht, wie lange es den jetzt gibt bestimmte sechs, sieben, acht Jahre nennt die Urversion. Die kostete glaube ich ursprünglich 40 Dollar, was ja sehr teuer wäre von Sensor, aber der hat ja wirklich da den Bastel Trip gestartet und mittlerweile gibt es auch Versionen, die viel günstiger hergestellt werden können, wo dann die Software drauf läuft. Und nicht jeder Sensor muss so ausgestattet sein, um den Raspberry PI, also oft reichender einfach nur einfachste Sensoren, die die Luftqualität messen oder den Wasserstand.

Was ich auch in ein schönes Beispiel finde, weil es einfach plastisch ist und man es sofort versteht, ist das ETT Computing am Beispiel des Smartphones. Also moderne Smartphones, Hamar, die Gesichtserkennung oder die Daumen Erkennung. Da wird ja auch das Gesicht quasi auf dem Gerät erkannt von der Person oder der Fingerabdruck auf dem Gerät. Das wird ja nicht übers Internet erst einmal zurückgeschickt. Hat noch nicht, wer weiß, wie das mal weitergeht. Aber das wäre ja auch ein klassischer Fall für Edge Computing.

Ah, okay, ich hab meinen Besitzer gefunden. Ich geb ihm Zugriff.

Ja genau.

Kennst du die Smartphone Anwendung?

Weiß Google gekauft worden ist?

Ja genau. Ehrlich.

Vor einigen Jahren schon.

Der ganze Firmen Nutzwert basiert im Prinzip darauf, dass das Smartphone oder die Menge an Smartphones gewissermaßen als Edge die Wais funktioniert, also dass es eine Verkehrs Navigation für. Vielleicht kennt das nicht jeder Zuhörer. Das Kartenmaterial war früher sehr teuer und ich weiß nicht wann Waas gestartet hat 2009 oder 2010. Und die hatten die Idee ja, im Grunde, wenn alle Autofahrer, die wissen wollen, wo viel Verkehr ist und wo wenig Verkehr, ihr Handy eingeschaltet haben während der Autofahrt, um die Navigation zu nutzen, dann können wir ja durch die Daten erkennen, wo Straßen sind, wo keine Straßen sind.

Also wenn alle Leute da lang fahren mit 80, dann ist da wohl eine Straße, weil so schnell läuft keiner und das kann man anhand von gewissen Metriken relativ gut erkennen. Und anhand der Menge und der Geschwindigkeit der Leute, die da lang fahren, wissen wir, ob da ein Verkehrsstau ist oder eben nicht. Das heißt, man hat sehr schnell alle. Wenn man diese Daten sammelt, hat man sehr schnell die Straßen aufgezeichnet und die Verkehrs Hotspots aufgezeichnet, wo immer Stau ist und kann dann eben die Daten in Echtzeit bereitstellen und dann auch alternative Routen vorschlagen.

Damit ist Weiß riesengross geworden.

Noch was ist mit Datenschutz?

Naja, du sammelst ja Daten von öffentlichen Straßen. Ich glaube das ist nicht strafbar. Ich weiß es aber nicht. Die Firma ist in Israel gegründet worden und hat da glaube ich auch gestartet. Aber ich kann es dir nicht sagen, ob das auch in der EU möglich gewesen wäre.

Ja, vermutlich nicht.

2009 vielleicht doch da war das Thema Datenschutz ja auch hier noch nicht so populär.

Hier vor allem aber an diesem Beispiel sieht man sehr schön, dass die Daten exponentiell steigen. Wenn die Smartphones jetzt untereinander kommunizieren, wirken sie kommunizieren ja trotzdem mit einem Server oder aggregieren die Daten und schicken die zyklisch an Server, um da zu sagen Hier ist eine Straße, hier ist eine Straße, weil ich vor 80 und das würde ich nicht dort tun, wo keine Straße ist. Und nicht nur hier ist eine Straße, sondern ist eine freie Straße, weil ich für 80 fahren kann.

Also finde ich ihn ziemlich schön. Case muss ich ehrlich sagen.

Er definitiv sehr smart, total.

Und ich glaube, da geht's auf jeden Fall hin. Ich glaube, das Thema Echtzeitdaten Verarbeitungen wird ein Riesending. Das merkt man jetzt schon. Also ganz, ganz viele Geschäftsprozessen. Da sammelt man irgendwelche Kundendaten und macht nachts einmal so ein Batch Job. Auch wie das so im Banksystem ist die Massen Überweisung und nachts werden die ganzen Überweisungen einmal vom Tag ausgeführt. Ich glaube es wird sich immer weiter Richtung Echtzeitdaten Verarbeitung verschieben. Im Privaten wie natürlich auch im professionellen Umfeld wie bei einer E-Mail.

Du schickst die E-Mail, die kommt sofort an oder bei seiner Messenger Nachricht du schickst die aus, kommt sofort an. Und genau so willst du das auch. Du willst ein Autohaus leihen und kriegst sofort die Zusage oder den Schlüssel sogar sofort. Du willst alles sofort haben und du wirst auch sofort wissen im Unternehmen, wie sie meine Kennzahlen und da brauchst du halt diese Edge, die Weißes, die kontinuierlich die Kennzahlen sammeln oder der Wiees der Wasserstand in dem Fluss.

Nein, dass man da immer up to date bleibt und im Grunde in Echtzeit sehen kann. Wie sieht es gerade aus? Wie ist deine Erfahrung? Glaubst du auch, dass es, wenn die Datenmenge steigt, dass diese Echtzeit Datenverarbeitung immer wichtiger wird?

Es zeichnet sich ja schon ab. Eine Unabhaengig, dass sich jetzt davon, dass die Datenmengen steigen, sondern dass es grundsätzlich gesellschaftliches Ding, dass man instant was haben will. Dadurch, dass sich das alles immer schneller dreht, Information viel schneller fließen werden. Diejenigen, die in Echtzeit Daten kriegen, ausgewertet kriegen und entscheiden, können halt im Vorteil sein und die anderen im Nachteil. So einfach ist die Rechnung.

Viele Daten, die gar nicht unbedingt in Echtzeit erhoben werden müssen es aber werden. Also z.B. ich kaufe seit einiger Zeit immer mit der Bahn App die Fahrkarte, wenn es jetzt nicht mehr lange im Voraus geplante Reise ist. So, aber das ist ja okay. Ich kauf die Fahrkarte zu einem gewissen Zeitpunkt meistens, wenn der Zug einfährt, weil bevor der Zug dich einfährt, glaub ich noch nicht so richtig dran, dass die Fahrt auch wirklich stattfindet.

So, das heißt früher, also vor 30 Jahren haben die Leute montags die Fahrkarte gekauft und sind irgendwann dienstags mittwochs gefahren.

Jetzt könnte ich aber, wenn ich Zugriff auf das Buchungssystem hätte, der Bahn könnte ich quasi in Echtzeit sehen, wo werden gerade welche Fahrkarten gekauft und da entstehen ja wieder neue Nutzungs Szenarien raus. Das mal ein wenig frequentierte Strecken, dass die Preise also man könnte sogar so Echtzeit. Mane wenig frequentierte Strecken oder Orte, wo die Hotels frei sind. Da wird Zeit sehr günstig, bei stark frequentierten Strecken wird es eher teurer. Weiß ich nicht, ob man das bei der Bahn machen kann, aber man sieht einfach gewisse Muster.

Man kann darauf dank Geschäfts Entscheidungen basieren lassen. Also gemäß einer Untersuchung der International Data Corporation, der IDC von 2018 soll der Anteil der Echtzeitdaten bis 20 25 auf 30 prozent der verarbeiteten Daten steigen. Ich halte das gar nicht für so unwahrscheinlich. Klar, weil die Datenmenge einfach steigt. Also 30 prozent der Daten sind wahrscheinlich dann die Echtzeitdaten, die auf einen zukommen. Ja und jetzt, da bist du ja gerade im Thema möchte ich gerne das Thema ETH Computing, das haben wir jetzt beleuchtet ein paar Beispielen, wie auf welche Vorteile und Nachteile es gibt, wie das mit 5G zusammenhängt.

2 Gerade bei 5G. Ich weiß nicht, wie es dir geht, aber da ist so viel am Marketing, Sprech und Halbwahrheiten und jeder überbietet sich mit irgendwelchen Zehnerpotenzen, wie schnell das alles sein soll. Und das ist physisch gar nicht möglich. Und vielleicht können wir dann ein bisschen Licht ins Dunkel bringen und mal das auf den technischen Boden erden und erklären, was da wirklich Sache ist.

Bei 5G also ich bin ja eher eine Glasfaser Ecke dran als das mobile Netz. Ich weiß nur, dass das von Ausbau relativ schleppend läuft. Das sind aber nur die Masten, das nicht schnell genug vorangeht, weil jeder hätte gern ein schnelles Netz, aber keine Sau will das Ding bei sicher auf dem Dach oder im Garten. Da ist aber ein anderes Problem. Ich weiß nur, dass es bei der Glasfaser ähnlich, dass die Zeit, die du also. Manche kennen, dass wenn du DSL bestellst und früher musste man hat man so ein Brief bekommen mit Teilnehmer Nummer und mit Teilnehmer Nummer und was nicht alles.

Und heute steckst du einfach dein Dingen editiere Dose und das Gerät Provision nährt sich von selbst, bekommt also die Zugangsdaten automatisch eingespielt, verbindet sich, kriegt ne IP und du kannst quasi 3 Minuten später loslegen. Telefonnummer wird schon drauf geschaltet. Das System weiß, wer du bist, welche Sachen du gebucht. Das und das Ganze passiert jetzt auch für Glasfaser und auch für 5G.

Das heißt man geht dort weg von proprietäre Lösungen.

Wo du einen Vendor Lock in hat es Vodoo meinen ein Splines gekauft das beim großen Herstellern wie Nokia Davao way und geht hin dazu Commodity Switches zu benutzen, die programmierbar sind. Und die ganze Logik, die vorhin der Hardware gesteckt hat, brauchst du extrahieren in Controller Software. Die entscheidet dann anhand von gewissen Daten. Okay, das ist der und der User, der wohnt da und da und programmiert quasi die Switches und stellt die Verbindungen zu deinem Glasfaser Modem her.

Kann das gleichzeitig alles überwachen in Echtzeit. Also da bewegt sich extrem viel. Und auch da bewegt man viel aus diesen großen monolithischen Rechenzentren zu der sogenannten Service Edge. Das heißt näher zum Kunden, zu dem sogenannten Central Office. Und das ist extrem spannend.

Da überschlagen sich die Telkos gerade mit mit Innovation, wie man das vorantreiben kann.

Mega spannend und bedeutet für den Kunden einfach, dass er viel schneller die Dienste bekommt, die er gebucht hat und auch viel schneller umstellen und sehr einfach unkomfortabel. Also da tut sich gerade Telkos mega viel.

Er Glasfaser ist natürlich das Rückgrat der 5G Infrastruktur One way Auch wenn du Gigabit Datenrate auch im Funk hast, dann bekommst du die ja sozusagen nur weg transportiert, wenn dahinter. Also wenn der Funkmast selber mit der schnellen Glasfaser Infrastruktur angebunden ist. Sonst bringt das ja nichts, wenn du einen Pendl die Daten schnell zum Funkmast senden kann. Aber da DSL Verbindung weitergemacht wird genau das sind natürlich nicht. Also Skepsis wissen viele nicht. Unterschiedliche 5G Standards bzw. der 5G STANDARD deckt ein sehr breites Spektrum ab.

Das 4G Spektrum, also das LTE Spektrum wird mit abgedeckt und da ist 5G bis auf ein paar kleine Veränderungen vergleichbar mit 4G. Nur es gibt eben noch ein sehr hochfrequenten Bereich, diese Milimeter Wellen, wo die Datenrate eben extrem steigen kann auf Kosten eben der Reichweite einer einzelnen Antenne. Das ist der Trade of hochfrequente Funkwellen. Die können irgendwann ab einer bestimmten Frequenz nicht mal mehr durch eine Wand, durch oder durch den Baum, durch oder durch Aquarium, also Wasser.

Das heißt, es muss viel, viel mehr dieser kleinen Sendemasten geben, die halt zentral aufgestellt sind. Ätsch, Sendemasten! Wenn man so möchte und wurde an dieser hohen Datenraten, die dort an der Stand anfallen könnten, in der Fußgängerzone zum Beispiel dann abtransportieren können. Und das ist sozusagen das echte 5G Leistungsversprechen, also was zumindest was die Datenrate angeht und auch die Latenz von keine Werbung wird immer von einer Millisekunde gesprochen für die Echtzeit Anwendung. Ich denke mal es wird so wird sich vielleicht bei 10 einpendeln, weil das weißt du auch die Latenz von deinem.

Zum Sendemast ist ja gar nicht so entscheidend, weil du ja irgendein Server im Internet erreichen musst und der hat ja auch noch Helm Latenz hintendran und da kann 5G gar nichts machen. Was ich gesehen hab, ist so ein ganz cooler Anwendungsfall. Ich hab persönlich immer das Problem Think Masiar. Einmal gibt es das 5G offene Netz, na klar, womit alle Leute mit ihrem Smartphone das nutzen können.

Und es gibt halt die sogenannten Campus Netze. Das heißt du baust quasi in einer Fabrikhalle dein eigenes 5G Netz auf. Eine Kaust hat deine eigenen Sendemast, den du so möchtest. Und da gibt's einen coolen Case hab ich gesehen. Und zwar ging es um eine Flugzeug Wartung, dass wirklich jemand mit dem Tablet durchgelaufen ist und ne Kamera und hat ja das Flugzeug gefilmt und ein Experte hat quasi in der Zentrale geguckt nach irgendwie Strukturveränderungen mit so einer Bildanalyse. Und da kannst du natürlich Borse nennen.

Super qualitativ hochwertiges Bild mit einer hohen Datenrate, wo du alles sehen kannst und wo man quasi gemeinsam mit der Person vor Ort die Inspektion von dem Flieger machen kann. Gar keine Frage. Für mich persönlich ist stellt sich dann immer die Frage Warum macht man es nicht auch mit WiFi? Das geht auch und ich glaube von dem, was ich hierzu gelesen habe die Zukunft. Das wird so eine Kombination sein aus WIFI 6 und 5G.

Im Grunde sowie heute schon im Gebäude hat es vielleicht WiFi. Im Flugzeug Hangar und draußen hast du 5G in der Fußgängerzone, so wie es heute schon ist.

Mich mit wieviel 6.1. beschäftigt. Was ist so anders?

Also die Leistungsversprechen sind ähnlich wie bei 5G eine drastische Steigerung der Bandbreite und erreicht wird das einfach durch mehr MIMO Streams, also das quasi parallele Funk Kanäle.

Eine Fritzbox hat glaub ich 4 oder 6 diese Kanäle liefern ne hohe Bandbreite jeder für sich. Die können aber auch zusammengeschaltet werden und das iPhone kann glaub ich zB kann 2 MIMO Kanäle belegen.

D.h.

Wenn du 6 Geräte hast, benutzt jeder einen Kanal und hat ne hohe Bandbreite.

Wenn du aber ein Kanal gerade nicht gebraucht wird, dann könnte ein Smartphone zwei Kanäle benutzen, drei Kanäle, vier Kanäle und das wäre so wie als wenn du vier Leitungen parallel zu diesem Gerät verbunden hättest.

Und dadurch kriegst du natürlich eine deutliche Steigerung der Datenrate hin. Ob das energieeffizient ist, kann ich nicht sagen. Ich persönlich finde die Möglichkeiten toll. Ich bin ja auch eigentlich ein Poweruser mit Videokonferenzen und so weiter. Ich habe selten den Fall, dass ich denke Oh, jetzt muss ich aber 50 Gigabyte auf die andere Seite des Globus schicken. Aber all das kann natürlich im Industrie Kontext immer vorkommen. Klar, für Unternehmen ist das natürlich etwas ganz anderes. Plus Du ermöglichst ja ganz neue Anwendungsfälle, wenn du so eine Datenrate ohne Probleme übertragen kannst.

Also ich denke gerade Medizinbereich Röntgenbilder durch die Gegend schicken zum Experten oder so. Da gibt's ja noch unfassbar viel Luft. Es gibt in allen Bereichen unfassbar viel Luft, aber ich glaube in manchen, in manchen ja. Spezial Wirtschaftsbereichen, die ich jetzt gar nicht so präsent hab, macht es einen deutlichen Unterschied, ob du sehr hohe Datenraten hast oder nicht.

Für sehr wenig Geld also z.B. auf der Bohrinsel. Da könnte ich mir vorstellen mach das halt. Ein Riesenunterschied, ob du alle Daten immer abgreifen kannst und dadurch ein Echtzeit Monitoring der Bohrinsel hast oder ob du das alles irgendwie lokal machen musst. Oder wenn du auf der Bohrinseln 3D-Drucker hast, um Ersatzteile ausdrucken zu können oder passende Schraubenschlüssel. Das hab ich mal gesehen. Er muss ja auch die Daten dahin transportiert bekommen. Zusätzlich gibt's bei 5G diesen Always on Modus, wie du das eben schon gesagt hast.

Also kleine Sensoren, die im Grunde sehr wenig Strom verbrauchen, aber immer online sind, also immer aufgeweckt werden können, wenn sie ein Datenpaket erhalten. Also ich denke, es wird sich schon durchsetzen.

Es gibt ja keine Alternative. Das ist einfach die nächste Evolutionsstufe.

Da gibts nur 6 g Gabis.

Bei uns ist mal alles ausgebaut ist.

Das wird schon entwickelt. Ich glaube was. Bei 5G gibt es so 2 Stufen. Es wird einmal jetzt dieses proprietäre 5G geben, was ihm sehr schnell ausgerollt werden wird und dann wird diese Technologie Software Hardware wird Open ran ein größeres Thema werden. Also wo Software dann diese heute proprietären Komponenten, die miteinander verschaltet sind die Antenne und die Bodenstation, das Kommunikations Modul dazwischen, das im Prinzip Open Source Software diese Funktionen übernehmen wird und dann wird der Preis für den 5G Ausbau denk ich auch nochmal deutlich sinken und die Durchdringung Rate wird halt einfach nochmal deutlich steigen, weil einfach ein Sensor wenn man ein 5G Masten so nennen möchte und eine 5G Antenne so senden nennen möchte, dann einfach nochmal viel günstiger produziert werden kann, passiert sehr viel.

Sehr spannend, gerade da Telkos.

Wenn unsere Zuhörer Fragen haben oder Feedback senden wollen, dann schickt uns gerne eine E-Mail an Podcast Skillbyte Punkt D Wir freuen uns immer über Bewertungen und natürlich über Abonnements unseres Podcasts. Empfehlt unser Podcast auch an eure Freunde und Kollegen weiter, die sich ebenfalls für die Themen interessieren. Schaut auf Skillbyte ist Lesch Blog vorbei für weitere spannende Technologie Themen und auf Skillbyte e slash Jobs. Wenn ihr im ity Umfeld einen Tapetenwechsel haben möchtet und einen Job sucht Masiar Ich danke dir vielmals für die Episode zum Thema Computing.

Danke dir auch Maurice.

Bis zum nächsten Mal.